あれ? 第9世代じゃなかったの?

Wi-Fiモデル発売

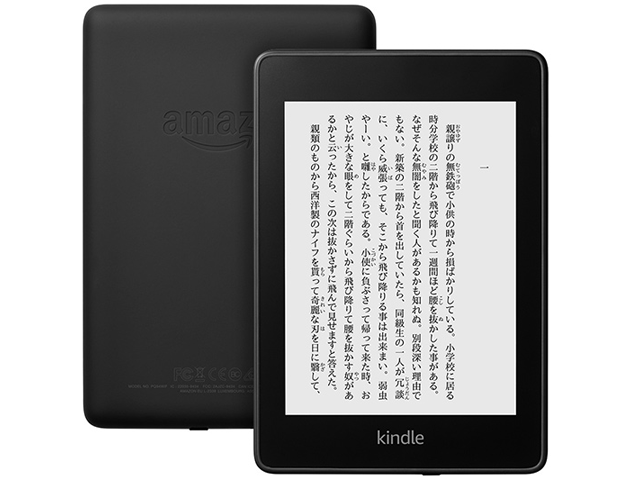

Amazonの電子辞書端末であるKindleの最も売れ線と考えられる製品「Kindle Paperwhite」のWi-Fiモデルが発売になった。 4G Cellularモデルは来月発売のようなのでまだ発売はされていないが、余程の事がない限りはWi-Fiモデルを購入する人が多いのではないかと思う。

4G Cellularモデルは来月発売のようなのでまだ発売はされていないが、余程の事がない限りはWi-Fiモデルを購入する人が多いのではないかと思う。

以前、このBlogでも10月17日に紹介はしたのだが、その際私は「第9世代」と紹介していた。

だが、Amazonの表記ルールでは製品の「世代」は原則として発売年ごとに付与されているそうで、今回発売されたニューモデルは「第10世代」になるという事らしい。なので、以前の「Paperwhite」は2015年発売の第7世代モデルという事になるが、だからといって第8世代とか第9世代が存在するというわけではないとの事らしい。

…何だか難しい解釈である。

何はともあれ、第10世代Paperwhiteが発売されたワケだが、その製品レビューが各所で行われている。

そうした記事を見てみると、概ね「Kindle Oasis」と性能的には互角といった印象である。

もっとも、Kindle Oasisは7型E-ink液晶だが、Paperwhiteは6型E-ink液晶なので、全く同じというわけではない。他にもページ送りボタンの有無の違いもあるし、それはそれで機能的な差異はあるのだが、そのページ送りの速度にしても、防水機能にしても、概ね機能的側面はKindle Oasisも第10世代Paperwhiteもあまり変わらないようである。

そういう意味では、第10世代Paperwhiteはコストパフォーマンスの高いKindleと言えるかもしれない。

専用機がいいのか?

Kindleの電子書籍を扱うという意味においては、何も専用端末でなければならないという事はない。

通常のAndroidタブレットやiPadでも問題はなく、場合によってはスマホでも問題はない。

Kindle用のアプリが用意されているので、そのアプリを使えば良いだけの話である。

だが、通常の液晶タブレットなどでは消費電力の関係から長期に渡って使用する事ができないなどの問題がある。言ってしまえば問題はソレしかないのだが、いつでもどこでもを売りにするのであれば、E-ink液晶端末である本機を使用するという手がある。

だが、E-ink液晶は実に癖が強くスクロール表示に弱かったり、あとモノクロでないと表示できないなどの問題がついて回る。

確かに稼働時間は他と比較にならないぐらい長いが、使い勝手という面で見た時、この6型E-ink液晶というものが、人を選ぶ要因の一つになっているように思う。

なので、もし今手元にタブレット端末を持っているなら、アプリでKindle本を読むのが良いかもしれないが、もし今手元にそうしたタブレット端末がない、というのなら、一考する価値はあるように思うし、実機を見てE-ink液晶の特性が気に入らなければ、別のタブレット端末を購入してKindleアプリを使うという方法を採った方がいいだろう。

ただ、個人的にはE-ink液晶は画面切り替えこそ問題はあるものの、静止画を表示する上では実に綺麗な画面を表示すると思っている。

具体的には、ベースクロックが1,257MHzから1,469MHz、ブーストクロックが1,340MHzから1,545MHzへと上昇した事でパフォーマンスアップが図られている。

具体的には、ベースクロックが1,257MHzから1,469MHz、ブーストクロックが1,340MHzから1,545MHzへと上昇した事でパフォーマンスアップが図られている。 4×4で構成されたパッドボタンはベロシティ対応で音に強弱を付けられるのだが、その強弱に合せてボタンの色が変わるという特徴を持つ。

4×4で構成されたパッドボタンはベロシティ対応で音に強弱を付けられるのだが、その強弱に合せてボタンの色が変わるという特徴を持つ。 広開本と呼ばれる製本からヒントを得たそうだが、マグネシウム合金製の一枚板を曲加工でフラップとして採用した事で、それが液晶の開閉に伴って可動する事で、後ろに倒れない支えになり、またキーボードを立たせてパームレスト不要の傾きを与える部材になるという。

広開本と呼ばれる製本からヒントを得たそうだが、マグネシウム合金製の一枚板を曲加工でフラップとして採用した事で、それが液晶の開閉に伴って可動する事で、後ろに倒れない支えになり、またキーボードを立たせてパームレスト不要の傾きを与える部材になるという。 音声およびSMS専用端末で所謂スマホの子機として利用できる端末である。

音声およびSMS専用端末で所謂スマホの子機として利用できる端末である。 唯一の弱点は、43型というその物理的サイズと重量。

唯一の弱点は、43型というその物理的サイズと重量。 指先がないので、指先は冷たくなるかも知れないが、サンコーのサイトが公開しているサーモグラフでは指先まで熱が伝わっている感じのようである。

指先がないので、指先は冷たくなるかも知れないが、サンコーのサイトが公開しているサーモグラフでは指先まで熱が伝わっている感じのようである。

最近のコメント