昨日インストールしてみたMPC VIDEO RENDERERだが、その効果はいかに?

インストールでコケる

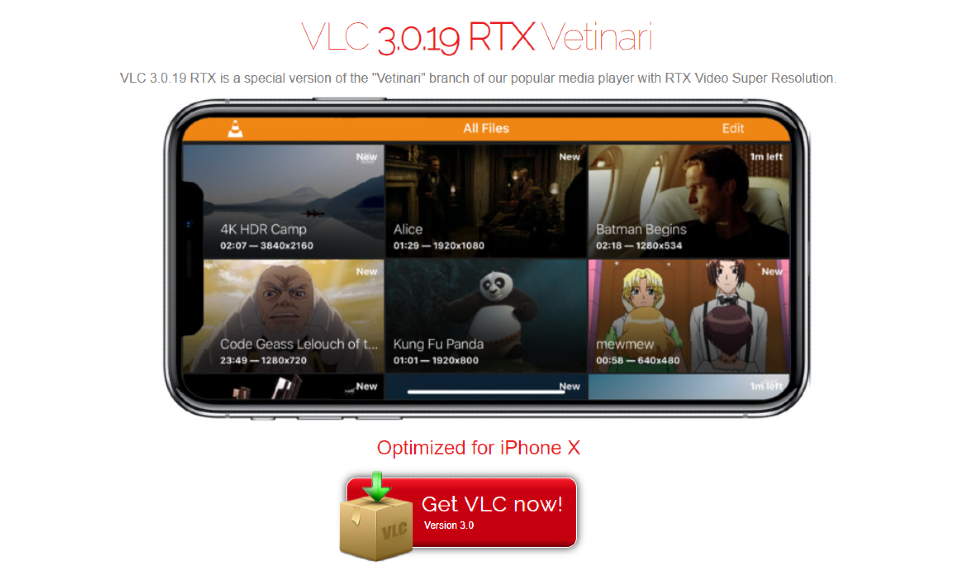

昨日、RTX VSRをローカル保存された動画で使用出来るという事を知り、その記事を書いた。

実際、この記事に書いた通りにインストールを進めたのだが、何故か「Install_MPCVR_64.cmd」を管理者で実行してもインストールに失敗し、コマンドライン上では「管理者で実行しろ」と言われて進めなかった。

私のWindows11の環境が悪いのかと、アカウントの見直しからいろいろと手を尽くしてみたが、解決できず、再度MPC VIDEO RENDERERのサイトを見ると、Release2という項目があったので、そこにある3月2日リリースのデータを見てみたら、インストーラーなど一部のデータのみ更新されているようで、こちらを使ってインストールを試みたところ、上手くインストールできた。

おそらく、初期リリースのアセットではPC環境によってインストーラに問題が出たのかもしれない。

とりあえず、Release2のインストーラでは上手くインストールできたので、実際にRTX VSRの効果を確認する事にした。

GPU負荷が40%を超える時も

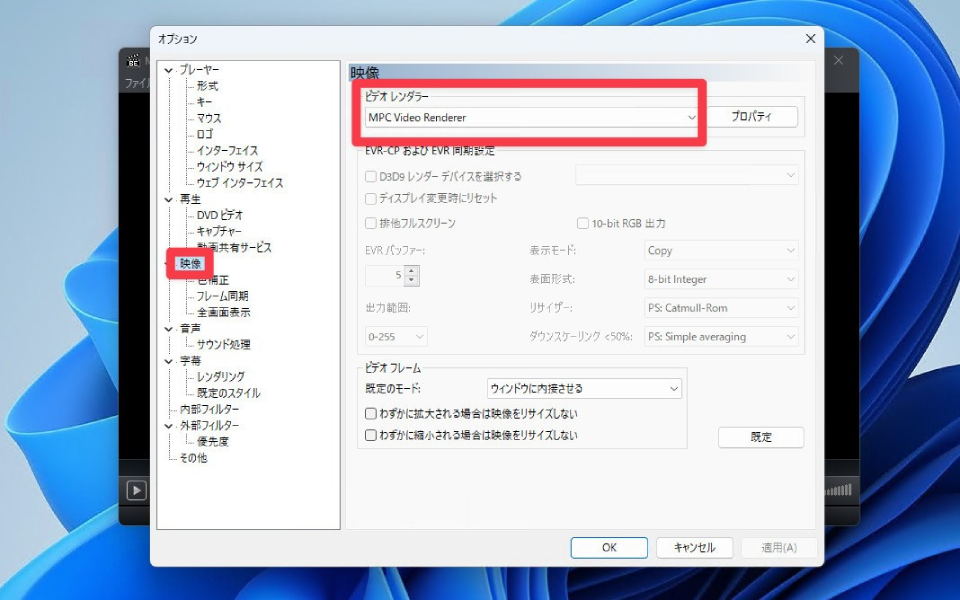

設定は昨日の記事の通りで、GeForceのドライバ設定もMPC-BEの設定も済ませ、まずは低解像度品質の動画を再生してみる。

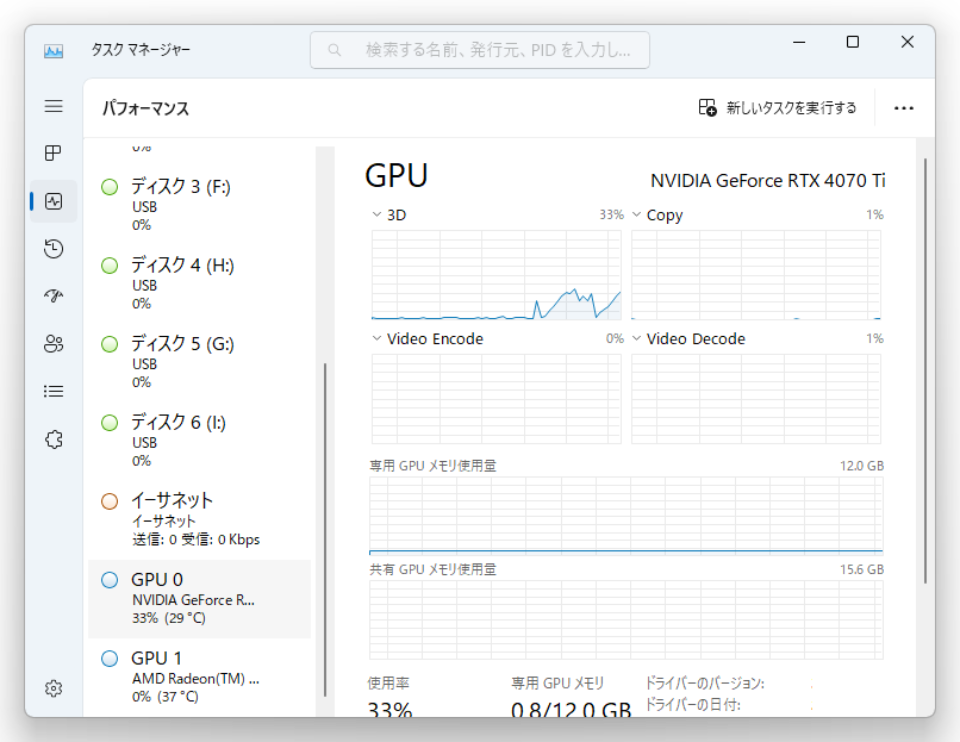

動画解像度は720×480のものを再生してみると、大凡20~30%の負荷がGPUにかかっているようで、これはアニメ調の動画だからこれぐらいの負荷で済んでいるのかも知れない。。

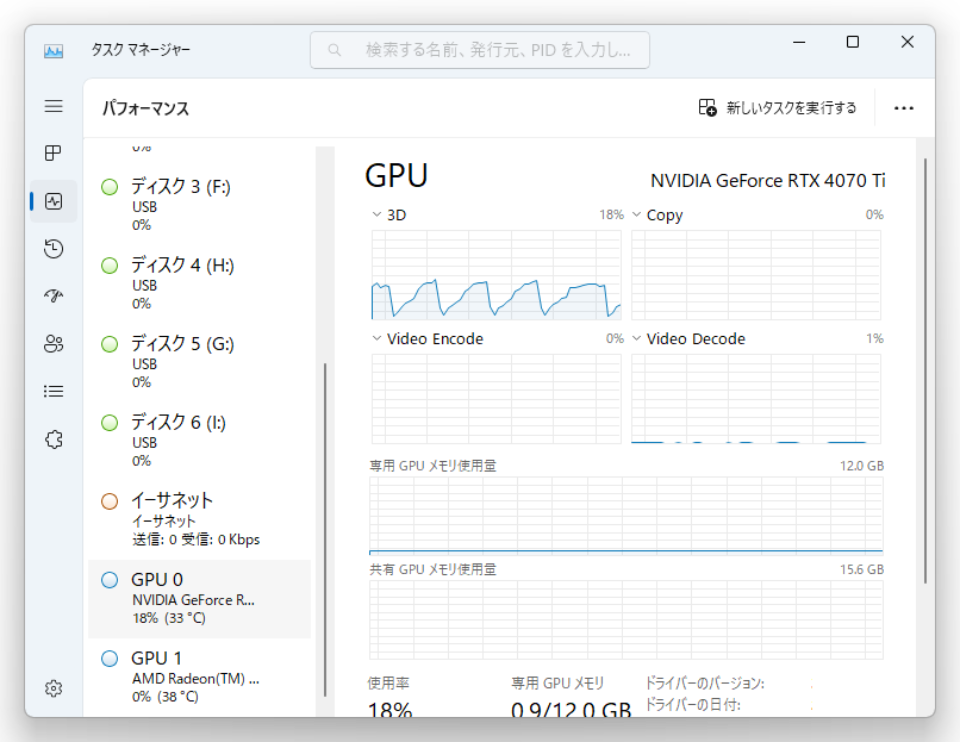

次に実写系の解像度720×480の動画をテストしてみるが、傾向としては似たようなものだが、面白いのは負荷がかかったり負荷が軽くなったりを繰り返す。

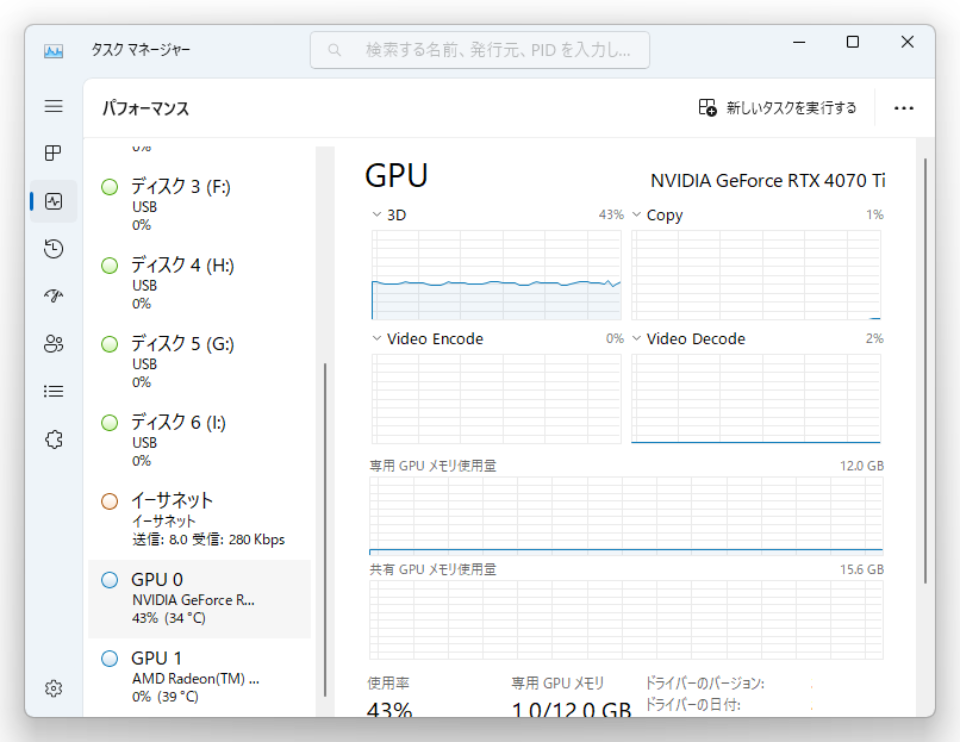

だが、今度は動画プレーヤーの窓をグッと広げ、画面の縦幅一杯に広げてみた。動画の表示解像度は2534×1426ドットになるが、これだとGPU負荷は一気に上がり、40%前後をずっと推移するようになる。

負荷に大きな乱れがなく、ずっと高負荷という状態が続き、GPU負荷35~45%という状態に張り付いた感じになった。

負荷に大きな乱れがなく、ずっと高負荷という状態が続き、GPU負荷35~45%という状態に張り付いた感じになった。

この状態の画質だが…おそらく人によって評価が割れるような気がする。

私個人としては、結構効果が出ている感じはしている。特に720×480ドットの元映像を2534×1426ドットの表示映像にしてみると判るのだが、細かい部分のディティールアップによってメリハリのある映像になっているような気がする。

比較画像に関しては他サイトで評価されているものを見てもらう方がわかりやすいと思うが、こういうのは映像として動いているもので見て評価したいところ。その感覚で言えば、私としては結構効果は出ているように思う。

個人的には、Media Player Classic BEを使う事が多いので、これに適用できるプラグインとかフィルターにしてくれるととても嬉しいのだが、オープンソース系プレーヤーだったら、期待していいのかな?(まぁ、私は他力本願な事しか言っていないので、大きな事はいえないのだが)。

個人的には、Media Player Classic BEを使う事が多いので、これに適用できるプラグインとかフィルターにしてくれるととても嬉しいのだが、オープンソース系プレーヤーだったら、期待していいのかな?(まぁ、私は他力本願な事しか言っていないので、大きな事はいえないのだが)。

一応、私が契約しているDTIの該当ページを見てみると、注意事項としての説明があるにはある。

一応、私が契約しているDTIの該当ページを見てみると、注意事項としての説明があるにはある。

アプリを起動させると、ライセンスの購入をするか、お試し利用するかを選択できるので、ここではお試し利用を選択する。

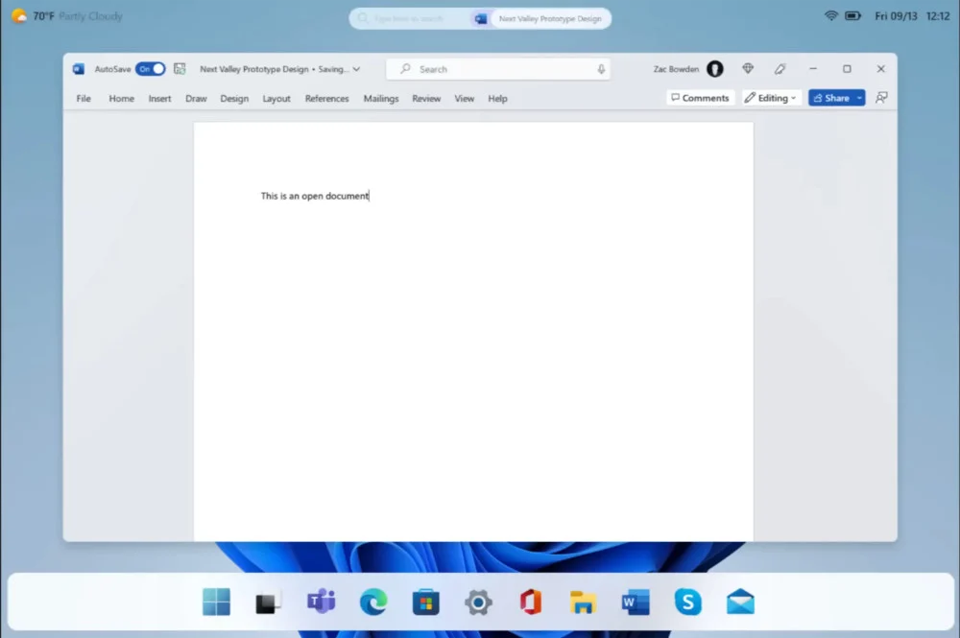

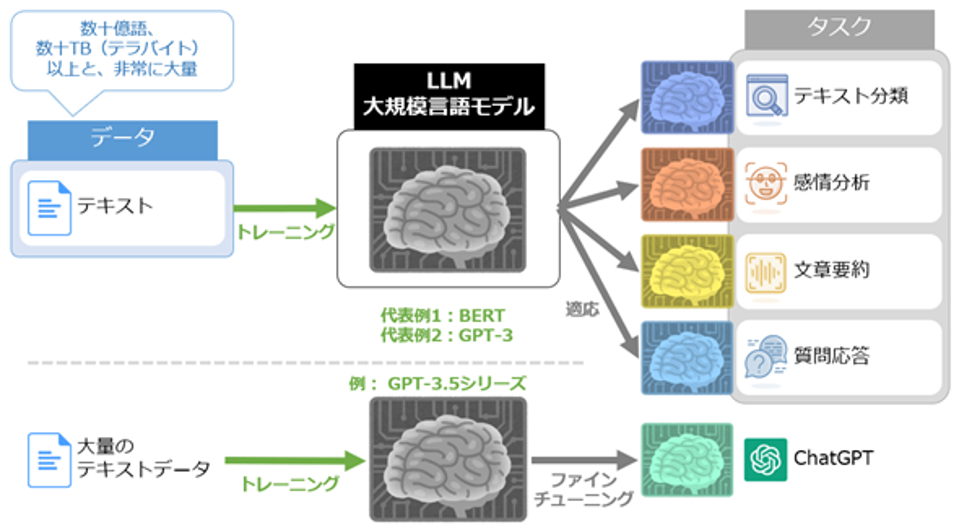

アプリを起動させると、ライセンスの購入をするか、お試し利用するかを選択できるので、ここではお試し利用を選択する。 統合されるAIは自然言語処理を使用しているChatGPTのようなAI技術で、Office製品にコパイロット、つまり副操縦士のようにAIが寄り添うOffice製品という位置付けになるようである。

統合されるAIは自然言語処理を使用しているChatGPTのようなAI技術で、Office製品にコパイロット、つまり副操縦士のようにAIが寄り添うOffice製品という位置付けになるようである。

最近のコメント